Логистическая регрессия является одной из самых популярных и широко используемых моделей машинного обучения. Она используется для решения задач классификации, когда требуется определить, к какому классу относится объект на основе его признаков. В данной статье мы рассмотрим, как работает обучение логистической регрессии и каким образом она выполняет прогнозирование классификации.

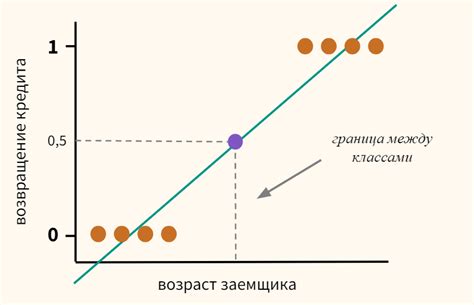

Логистическая регрессия использует логистическую функцию для преобразования признаков объекта в вероятность принадлежности к одному из классов. Она создает гиперплоскость, разделяющую области признаков на два класса. Чем ближе объект к этой плоскости, тем больше вероятность его принадлежности к классу.

Обучение логистической регрессии заключается в нахождении оптимальных весов, минимизирующих ошибку модели. Для этого используется градиентный спуск, который находит локальный минимум функции потерь. Цель обучения - максимизация вероятности правильной классификации объектов путем оптимизации функции потерь, учитывающей разницу между предсказанными и реальными значениями классов.

Что такое логистическая регрессия и примеры ее применения

Логистическая регрессия находит оптимальные параметры модели, соответствующие данным, с помощью логистической функции потерь.

Примеры применения:

- Прогнозирование оттока клиентов в банке.

- Медицинская диагностика.

- Фильтрация спама.

Логистическая регрессия является мощным инструментом в задачах классификации и используется в различных областях, где требуется прогнозирование классификации на основе доступных данных.

Какие классификации можно прогнозировать с помощью логистической регрессии

Логистическая регрессия широко применяется в медицине, маркетинге, финансах и машинном обучении. С ее помощью можно прогнозировать различные классификации, включая:

- Болезнь/здоровье: Определение вероятности наличия или отсутствия болезни на основе клинических данных пациента.

- Кредитный риск: Оценка вероятности невозврата кредита клиентом на основе его финансовых данных и кредитной истории.

- Потребительские предпочтения: Логистическая регрессия используется для прогнозирования предпочтений потребителей на основе их профилей и ранее сделанных выборов.

- Спам/не спам: Логистическая регрессия применяется в фильтрах спама для определения вероятности того, что письмо является спамом или не спамом на основе его содержания и других признаков.

- Прогнозирование оттока клиентов: Логистическая регрессия может помочь оценить вероятность того, что клиент покинет компанию на основе его истории взаимодействия и других факторов.

Это лишь некоторые примеры классификаций, которые можно прогнозировать с помощью логистической регрессии. Она один из наиболее распространенных и эффективных методов для решения задач классификации и может быть применена к широкому спектру проблем в различных областях.

Подготовка данных для логистической регрессии

Для обучения логистической регрессии необходимо правильно подготовить данные. Они должны быть структурированными и подходящими для классификации.

Сначала данные должны быть векторизованы. Каждая единица данных представлена в виде вектора чисел, где каждая размерность соответствует определенному признаку. Например, при классификации писем на спам и не спам, каждое письмо может быть представлено вектором, где каждая размерность указывает наличие или отсутствие определенного слова.

Данные нужно разделить на обучающую и тестовую выборки. Обучающая выборка используется для обучения модели, а тестовая - для проверки точности модели. Обычно данные делятся на 70% для обучения и 30% для тестирования.

Также данные могут быть предварительно обработаны для улучшения модели. Например, удаление выбросов, заполнение пропущенных значений, масштабирование признаков и другие операции. Иногда нужно балансировать классы, если в данных наблюдается несбалансированность.

Как происходит обучение логистической регрессии

Обучение логистической регрессии происходит в несколько этапов:

- Инициализация весов. В начале обучения веса модели инициализируются случайными значениями. В дальнейшем они будут обновляться с помощью градиентного спуска для нахождения наилучших параметров.

- Вычисление предсказаний. С помощью определенной функции (например, сигмоида) и текущих значений весов модели происходит вычисление предсказаний для всех объектов в обучающей выборке. На этом этапе получаем вероятности принадлежности объектов к классу 1.

- Вычисление ошибки. Далее с помощью функции потерь (например, кросс-энтропия) вычисляется ошибка модели для каждого объекта в обучающей выборке. Задача обучения – минимизировать эту ошибку.

- Обновление весов. Для определения оптимальных значений весов используется градиентный спуск. Веса модели обновляются в направлении, противоположном градиенту функции потерь. Этот процесс повторяется до достижения критериев останова (например, определенного количества итераций или минимальной ошибки).

- Оценка качества модели. После завершения обучения модели происходит оценка ее качества на отложенной выборке. Это позволяет оценить, насколько хорошо модель предсказывает новые данные и принять решение о применимости модели для задачи классификации.

В результате обучения получается модель, которая может классифицировать новые объекты на основе их признаков. Логистическая регрессия является простым и эффективным алгоритмом для бинарной классификации и широко применяется в различных областях, таких как медицина, финансы, маркетинг и многие другие.

Какими способами можно оценить качество модели логистической регрессии

После обучения модели необходимо оценить ее качество и эффективность. Для этого существует несколько методов оценки:

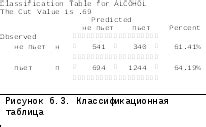

- Матрица ошибок: оценка точности классификации модели. Включает количество верно и неверно классифицированных примеров.

- Точность (Accuracy): доля верно классифицированных примеров от общего числа. Чем ближе к 1, тем лучше качество модели.

- Полнота (Recall): доля верно классифицированных положительных примеров от всех положительных. Оценка способности модели обнаруживать положительные примеры.

- Точность (Precision): доля верно классифицированных положительных примеров от общего числа примеров, классифицированных как положительные. Позволяет оценить способность модели правильно классифицировать положительные примеры.

- F-мера (F1-score): среднее гармоническое между точностью и полнотой. Она используется для объединения двух метрик в одно число, учитывающее как точность, так и полноту модели.

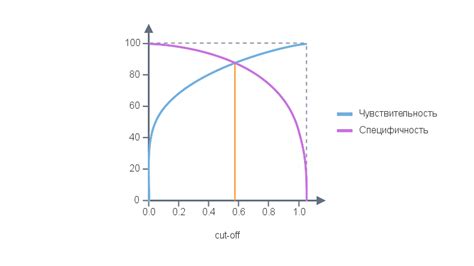

- ROC-кривая: графическое представление зависимости между долей верных положительных классификаций (True Positive Rate) и долей ложных положительных классификаций (False Positive Rate) для различных значений порога классификации. ROC-кривая позволяет оценить производительность модели при различных пороговых значениях и выбрать оптимальный порог классификации.

Выбор оценки качества модели логистической регрессии зависит от конкретной задачи и требований к модели. Рекомендуется использовать несколько метрик одновременно, чтобы получить более полное представление о качестве модели.

Преимущества и недостатки логистической регрессии и альтернативные методы классификации

| Преимущества логистической регрессии | Недостатки логистической регрессии |

|---|---|

| 1. Простота в понимании и реализации. | 1. Логистическая регрессия не способна моделировать сложные взаимосвязи между признаками. |

| 2. Устойчивость к шуму и выбросам в данных. | 2. Логистическая регрессия дает только линейное решение. |

| 3. Может быть использована для прогнозирования вероятностей классификации. |

| 3. Логистическая регрессия требует, чтобы данные были линейно разделимыми. | |

| 4. Легко обновлять модель с добавлением новых данных. | 4. Подвержена проблеме проклятия размерности при большом количестве признаков. |

Кроме логистической регрессии, существуют также альтернативные методы классификации. Некоторые из них включают:

- Метод опорных векторов (Support Vector Machines) - основная идея этого метода заключается в нахождении гиперплоскости, которая максимально разделяет классы.

- Случайный лес (Random Forest) - данный метод основан на ансамблевом подходе и комбинирует множество деревьев решений для достижения более точной классификации.

- Нейронные сети (Neural Networks) - могут моделировать сложные взаимосвязи между признаками и решать разнообразные задачи классификации.

Выбор метода классификации зависит от данных и поставленной задачи. Логистическая регрессия подходит для простых задач с линейно разделимыми данными, но для сложных задач лучше применять более сложные методы.