Глубокое обучение - это часть искусственного интеллекта, которая моделирует работу человеческого мозга. Основано на нейронных сетях, способных обрабатывать сложные данные и паттерны. Одним из главных принципов является классификация и анализ данных.

Глубокое обучение создает искусственные нейронные сети, имитирующие работу человеческого мозга. Нейроны связаны между собой и передают сигналы на основе данных.

Отличие глубокого обучения от других методов в том, что оно использует многослойные нейронные сети для анализа информации.

Важным принципом является обратное распространение ошибки. Нейронная сеть анализирует ошибки, корректируя соединения для улучшения результатов.

Принципы глубокого обучения

1. Иерархичность

Глубокое обучение основано на иерархичной структуре нейронных сетей. Каждый слой извлекает абстрактные признаки на основе предыдущих слоев, что позволяет обрабатывать сложные данные, такие как изображения или аудио, и распознавать более высокоуровневые понятия.

2. Глубокая специализация

Глубокое обучение помогает нейронным сетям стать экспертами в определенной области за счет специализации различных слоев обработки данных. Каждый слой может быть специализирован на извлечении определенных признаков, что позволяет сети эффективно решать задачи в своей области.

3. Автоматическое обучение

Обучение нейронных сетей в глубоком обучении происходит автоматически. Нейронные сети могут самостоятельно обучаться на больших объемах данных, без необходимости ручного определения признаков или выборки обучающих примеров. Благодаря этому, глубокие нейронные сети могут обнаруживать сложные, неразделимые закономерности в данных.

4. Обобщение

Глубокое обучение позволяет нейронным сетям обобщать знания и решать новые задачи. Нейронные сети, обученные на одной задаче, могут применять полученные знания для решения аналогичных задач. Благодаря этому, глубокие нейронные сети могут быть переиспользованы и предоставлять значимые результаты на новых данных.

5. Гибкость

Глубокое обучение обладает высокой гибкостью и может быть адаптировано для разных типов данных и задач благодаря различным архитектурам нейронных сетей, типам слоев и функций активации.

6. Необходимость больших вычислительных ресурсов

Глубокое обучение требует значительных вычислительных ресурсов для тренировки и использования нейронных сетей, включая использование графических процессоров (GPU) или распределенных вычислительных систем. Также требуется большой объем памяти для хранения весов и активаций.

Все эти принципы помогают глубокому обучению быть эффективным в решении различных задач.

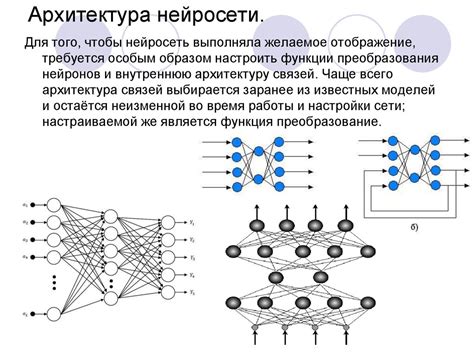

Многослойность нейронных сетей

Нейронные сети моделируют нелинейные зависимости между входными и выходными данными. Каждый слой нейронов обрабатывает информацию и передает ее на следующий слой, что позволяет изучать все более сложные абстракции.

Глубокие нейронные сети содержат несколько скрытых слоев, называемых полносвязными слоями. Нейроны каждого слоя передают информацию на следующий слой, что позволяет извлекать иерархические признаки и получать более точное представление данных.

Каждый слой нейронной сети имеет свои веса и функцию активации, которые определяют, как информация будет обработана на этом слое. Веса соединений между нейронами обновляются в процессе обучения сети, чтобы минимизировать ошибку и улучшить качество работы модели.

Многослойность позволяет глубоким нейронным сетям вырабатывать более сложные представления данных, чем однослойные модели. Это значительно увеличивает возможности сетей в решении задач машинного обучения, включая обработку изображений, речи, текстов и других типов данных.

| Пример многослойной нейронной сети с использованием полносвязных слоев. |

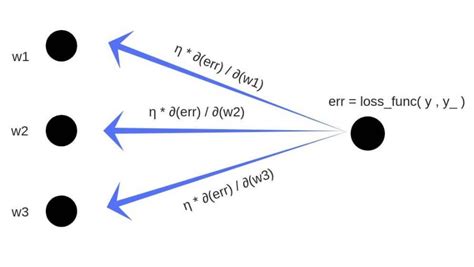

Обратное распространение ошибки

Процесс обратного распространения ошибки состоит из нескольких шагов:

1. Прямое распространение

Нейронная сеть получает входные данные и вычисляет значения нейронов на основе весов.

2. Вычисление ошибки

Сравниваются полученные предсказания с ожидаемыми значениями, вычисляется ошибка.

3. Обратное распространение

Ошибки передаются назад через сеть, вычисляются "части ошибки" для каждого нейрона и распространяются на предыдущие слои.

4. Обновление весов

На основе полученных значений "частей ошибки" веса каждого нейрона обновляются с помощью градиентного спуска. Веса меняются для минимизации ошибки предсказания и повышения точности модели.

Обратное распространение ошибки играет важную роль в обучении нейронных сетей, позволяя достигать высокой точности в решении сложных задач, таких как распознавание образов и обработка естественного языка.

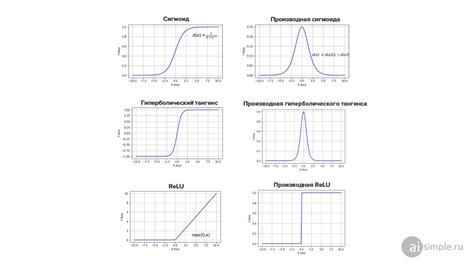

Функции активации

Одной из популярных функций активации является сигмоидная функция, преобразующая входные значения в диапазон от 0 до 1 с гладкостью. Она часто применяется в задачах бинарной классификации для определения принадлежности объекта к определенному классу.

Гиперболический тангенс преобразует значения от -1 до 1, подходит для данных с большим разбросом.

ReLU и ее модификации активно применяются в современных нейронных сетях. ReLU обнуляет отрицательные значения и оставляет положительные без изменений, проста и эффективна в обучении сети.

Существуют и другие функции активации, такие как softmax, линейная функция и показательная функция, выбор влияет на результаты нейронной сети.

Важно учитывать задачу и выбирать подходящую функцию активации для достижения нужных результатов при настройке нейронных сетей.